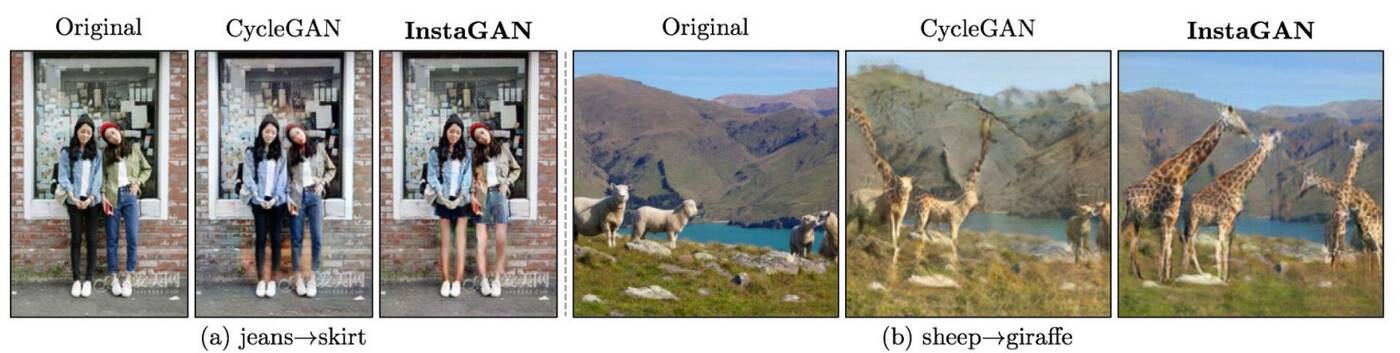

Zamiana owiec na żyrafy, czy może jeansów na spódnice? Nie są to może najbardziej znamienite osiągnięcia tego algorytmu, ale wystarczy tylko przepuścić przez niego inne zbiory danych, aby twór bazujący na uczeniu maszynowym, opracowany przez naukowców z Koreańskiego Zaawansowanego Instytutu Nauki i Technologii oraz Uniwersytetu Nauk i Technologii w Pohang przekształcał cokolwiek w cokolwiek. Cały ten proces został opisany w artykule InstaGAN: Instance-Aware Image-to-Image Translation opublikowanym w tym tygodniu.

W dzisiejszych czasach podobne systemy nie są czymś nowym, co pokazuje np. osiągnięcie z początków grudnia. Wtedy to badacze Google AI opracowali model, który realistycznie może wstawić obiekt na zdjęciu, przewidując jego skalę, okluzje, pozy, kształty i wiele innych zmiennych. Jak jednak stwierdzili twórcy InstaGANu (o których właśnie mowa), nawet najnowocześniejsze metody nie są zawsze doskonałe. Gadać oczywiście może każdy, ale popierać swoje opinie czymś wartościowym już nie.

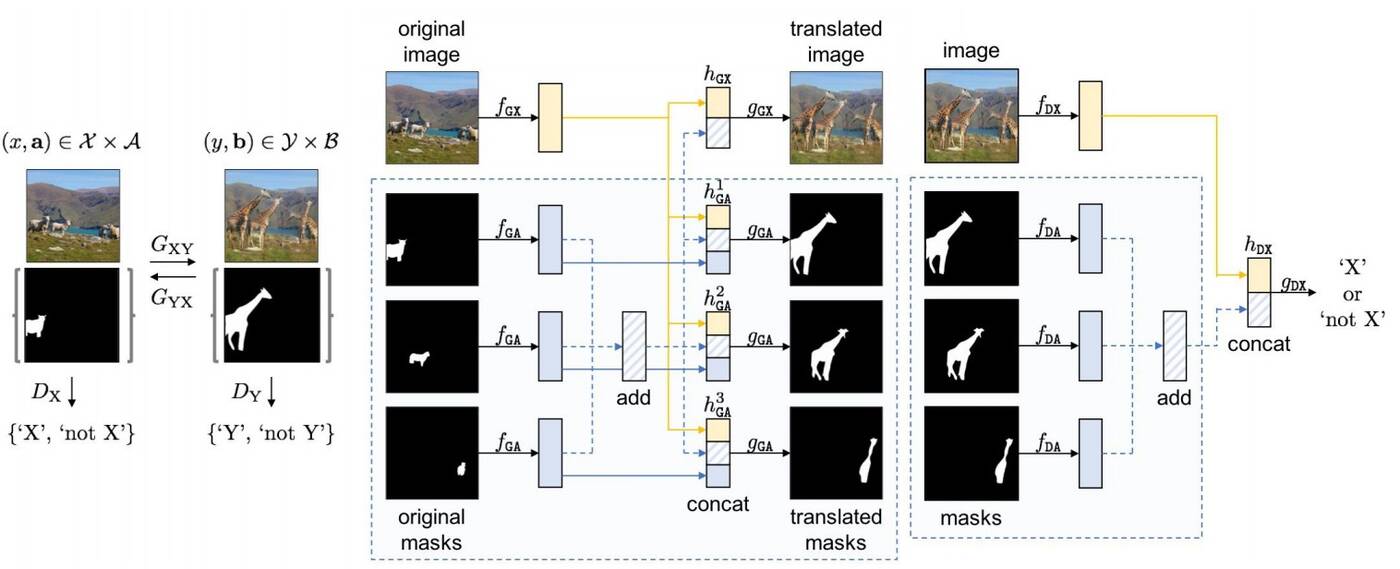

Stąd też prezentacja opracowanego przez nich systemu InstaGAN, który zawiera informacje o instancji wielu obiektów docelowych. W tym przypadku są to tak zwane maski segmentacji obiektów (grupy pikseli, które należą do tego samego obiektu), które w użyteczny sposób wytyczają granice poszczególnych obiektów, ignorując szczegóły takie jak kolor.

Nowością w InstaGAN jest to, że oparty o SI system tłumaczy zarówno obraz, jak i odpowiadający mu zestaw atrybutów poszczególnych elementów obrazka, starając się zachować kontekst tła. W połączeniu z innowacyjną techniką, która pozwala na obsługę dużej liczby atrybutów instancji na konwencjonalnym sprzęcie, może generalizować nawet najbardziej złożone obrazy. Czy to działa? A owszem, o czym mają przekonać nas przykładowe próbki (CycleGAN to swojego rodzaju protoplasta finalnego InstaGAN):

Czytaj też: Ten system SI uczy roboty chodzenia

Źródło: Venturebeat

Zdjęcia: Medium, InstaGAN