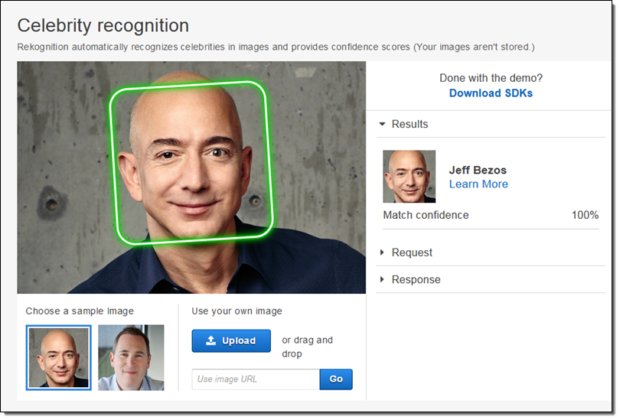

Badania sugerują, że narzędzie analizy twarzy Amazona zwane Rekognition zmaga się z dyskryminacją ze względu na płeć i rasę. MIT Media Lab stwierdził, że system nie miał żadnych problemów z prawidłowym wskazaniem płci mężczyzn o jasnym odcieniu skóry, ale już zmagało się z klasyfikowaniem kobiet z naciskiem na te o ciemniejszej karnacji.

Z testu wynika, że 20% wszystkich kobiet uczestniczących w badaniu zostało uznanych za mężczyzn, co w przypadku tych o ciemnoskórych rosło już do 33%. Jednak Amazon broni swoje narzędzie Rekognition, podważając te wyniki MIT z 2018 roku. Według niego testerzy nie wykorzystali aktualnej wersji systemu, a na dodatek użyli nie algorytmu rozpoznawania twarzy, a jej analizy, co dotyczy zupełnie odmiennego pakietu oprogramowania.

Podaje tym samym swoje badania, według których Rekognition nie popełniło żadnego błędu w rozpoznawaniu z progiem zaufania ustawionym na 99%. Nie ominęło to jednak Amazonu przed zarzutami dyskryminacji płci i rasy, co nie jest specjalnie rzadkie. Dlatego też IBM udostępnił w przeszłości zbiór danych, który ma poprawić dokładność narzędzi analizujących twarz.

Amazon ma jednak nadal problem, bo w listopadzie zwrócili się do niego prawnicy z prośbą o udzielenie odpowiedzi na decyzję o dostarczeniu Rekognition do organów ścigania, uznając, że odpowiedź firmy na oskarżenia jest niewystarczająca. Ponadto niektórzy akcjonariusze poprosili nawet Amazona, aby ten nie sprzedawał technologii, ponieważ mają obawy co do naruszania przez nią praw obywatelskich.

Czytaj też: Amazon uruchomił usługę autonomicznych robotów kurierów

Źródło: Engadget