Speech2Face jest siecią neuronową przeszkoloną przez naukowców tak, że myśli w sposób podobny, co nasz mózg. Więc czy kiedykolwiek wyobrażałeś sobie wygląd osoby, której nigdy nie widziałeś, po prostu opierając się na jej głosie? Jeśli tak, to nic więcej ci nie potrzeba, żeby pojąc działanie wspomnianej sztucznej inteligencji, która generuje twarze ludzi tylko i wyłącznie na podstawie ich głosu.

Czytaj też: Sztuczna inteligencja wytwarza więcej CO2 niż samochody

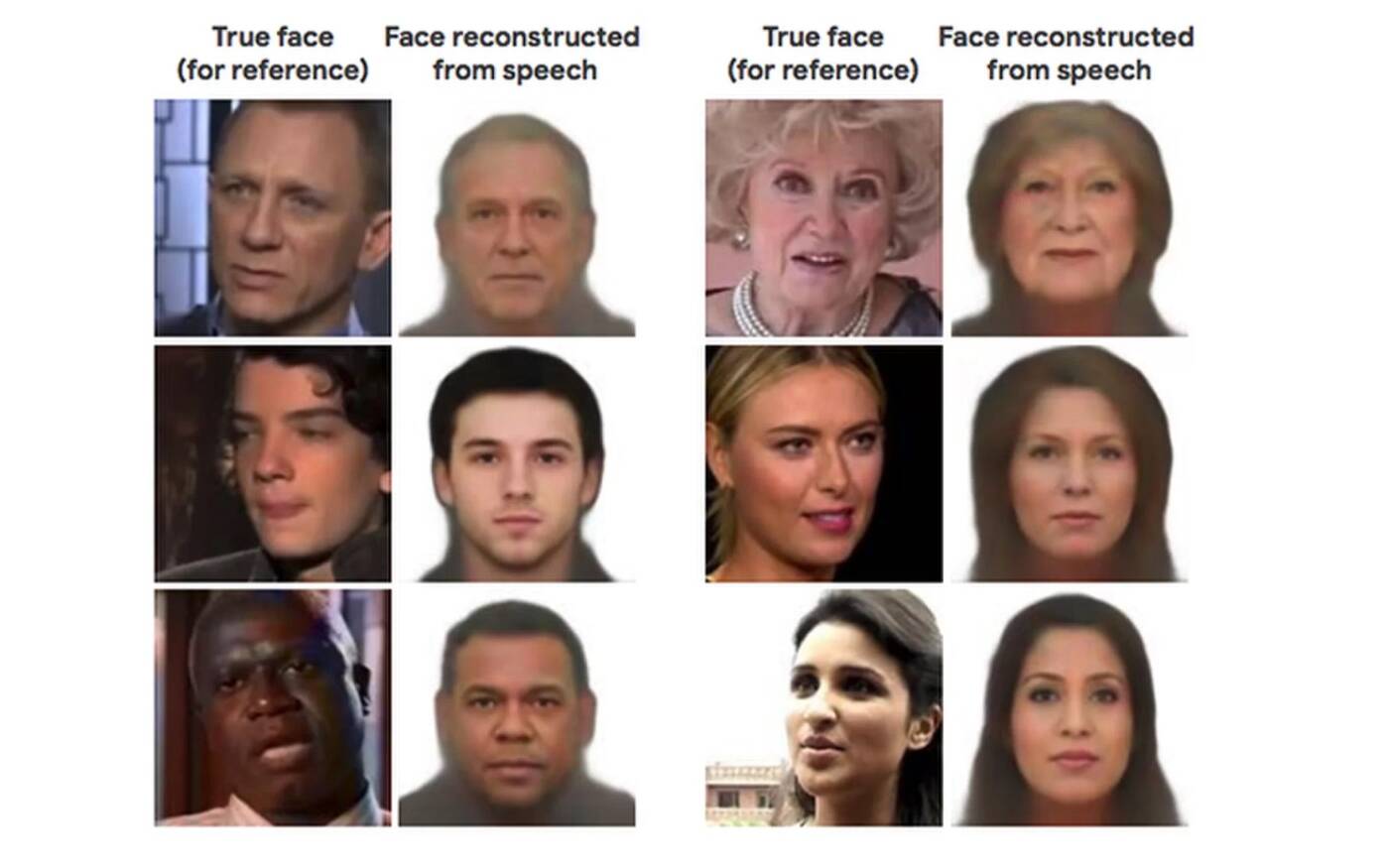

Do wyszkolenia Speech2Face były potrzebne miliony filmów edukacyjnych z udziałem ponad 100000 różnych osób. Najpierw wysłuchiwała nagrań, a później łączyła je ze zdjęciami lektora lub rozmówcy. Na podstawie tego zbioru danych ta sztuczna inteligencja nauczyła się „powiązań między sygnałami głosowymi a pewnymi cechami fizycznymi na ludzkiej twarzy”. Dzięki temu na podstawie tylko i wyłącznie samego nagrania była w stanie wygenerować fotorealistyczną twarz, która jako-tako pasowała do zdjęcia aktora głosowego.

Jednak SI nie wie (jeszcze) tego, jak dokładnie wygląda konkretna osoba na podstawie jej głosu. Sieć neuronowa rozpoznała pewne kluczowe szczegóły w mowie, które wskazywały na płeć, wiek i pochodzenie etniczne, czyli te cechy, które są wspólne dla wielu ludzi. Ze względu na to komputer generuje tylko przeciętnie wyglądające twarze i „Nie będzie wytwarzać obrazów konkretnych osób”.

Jak to z algorytmami bywa i ten ma swoje bolączki. Kiedy na przykład przysłuchiwał się nagraniu Azjaty mówiącego po chińsku, program wytworzył obraz azjatyckiej twarzy. Jednakże, gdy ten sam mężczyzna mówił po angielsku w innym klipie audio, AI wytworzyło twarz białego człowieka. Algorytm wykazywał również uprzedzenia płciowe, kojarząc niskie głosy z męskimi twarzami i wysokimi głosami z kobiecymi twarzami.

Czytaj też: Ta kosiarka jest szybsza od Twojego samochodu

Źródło: LiveScience