Dziennik Proceedings of the National Academy of Sciences wzbogacił się w ostatnim tygodniu o publikacje, która bezpośrednio wskazuje na to, jak prawdziwe mogą wydawać się twarze ludzi… którzy nigdy nie istnieli. W ramach tego eksperymentu udowodniono, że sztuczna inteligencja wygenerowała twarze, które oszukują większość z nas.

Stworzona przez NVIDIA sztuczna inteligencja wygenerowała twarze, które ponownie budzą strach przed deepfake

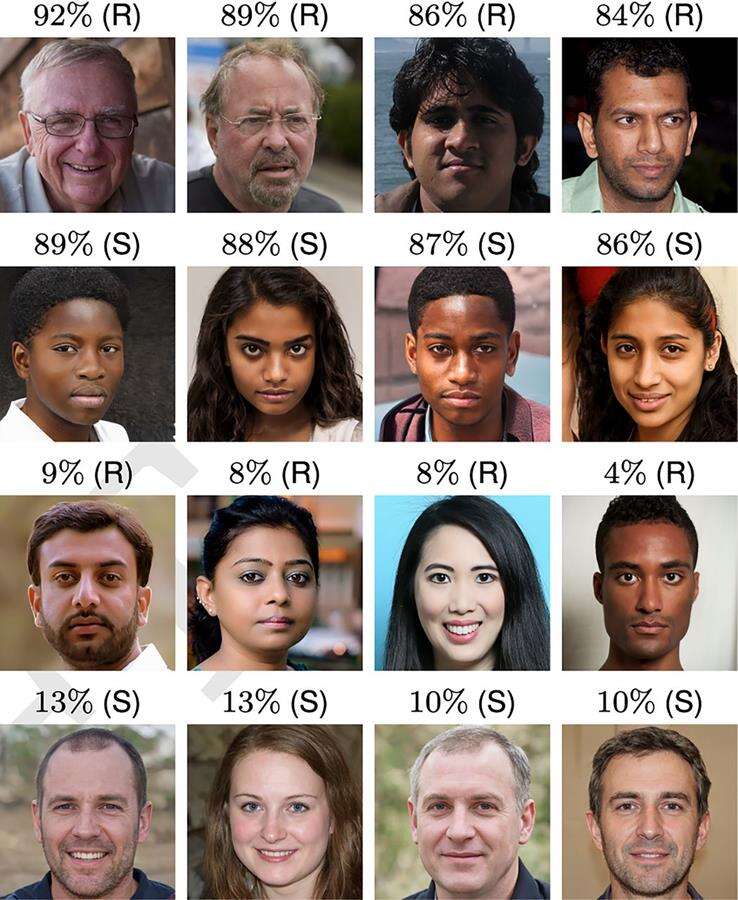

W tym badaniu poproszono ponad 300 uczestników o określenie, czy dane zdjęcie jest rzeczywistym prawdziwej osoby, czy też to falsyfikat, którego wygenerowała sztuczna inteligencja. Wyniki? Widzicie je powyżej, gdzie procenty oznaczają skuteczność wskazywania wygenerowanych z pomocą sztucznej inteligencji (S) i prawdziwych (R) osób, prezentując w pierwszych dwóch wersach te najbardziej wiarygodne zdjęcia i najmniej w dwóch od dołu.

Wynika z tego, że ludziom udawało się wskazać dobrze mniej, niż w połowie przypadków (48,2%). To oznacza, że gdyby Internet zalały twory deepfake bez żadnej kontroli, to oceniając widoczne na zdjęciach, czy nagraniach ludzi lepiej byłoby rzucić monetą, niż samodzielnie oceniać, czy dane zdjęcie przedstawia kogoś rzeczywistego, czy tylko twór SI. Nawet jeśli wiemy, jak oceniać sztuczne zdjęcia, bo nawet z tą wiedzą wynik 48,2% wskoczył do zaledwie średnio 59-procentowej skuteczności w odróżnianiu rzeczywistego zdjęcia od falsyfikatu.

Czytaj też: Uważajcie na swoje portfele z kryptowalutami. Kraken już na czyha, obchodząc Windows Defendera

Według badania „ten wyczyn inżynierów należy uznać za sukces w dziedzinie grafiki komputerowej” i jednocześnie nawołuje do „zastanowienia się, czy związane z nim ryzyko nie przewyższa korzyści”. Dotyczy to całego spektrum zagrożeń – od kampanii dezinformacyjnych, aż po generowanie treści pornograficznych.

Być może najbardziej szkodliwe jest to, że w cyfrowym świecie, w którym każdy obraz lub wideo może zostać podrobiony, autentyczność każdego niewygodnego lub niepożądanego nagrania może zostać zakwestionowana

– twierdzą badacze.