Robienie zdjęć czy nagrywanie filmów jest bardzo przyjemne, jednak w tej dziedzinie jest jedna rzecz, które denerwuje jak nic. Gdy zaczniemy powiększać obraz to w pewnym momencie zacznie stawać się on rozmazany i niewidoczny. Okazuje się, że niedługo może się to zmienić.

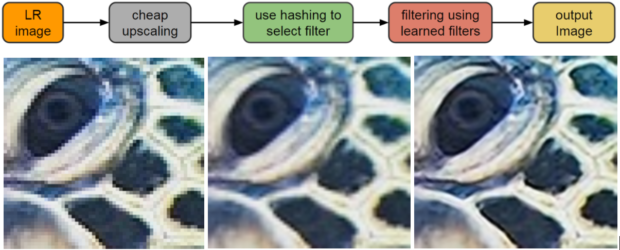

Obrazy składają się z małych punktów, zwanych pikselami. Im ich więcej jest (większa rozdzielczość) tym więcej szczegółów można zobaczyć. Zawsze można też dotrzeć do punktu, gdzie na ekranie będzie widać tylko szachownicę pikseli. Google stara się to zmienić poprzez wykorzystanie technik maszynowego uczenia się. Firma podobno wymyśliła taką technikę, która pozwala na rekonstrukcję detali w obrazach o niskiej rozdzielczości. Nazwana ona została RAISR (rapid and accurate image super-resolution). Polega ona na uczeniu programowym na tzw. krawędziach obrazu (części obrazu z drastycznymi zmianami w gradiencie koloru i jasności)i próbuje je odtworzyć. Niska rozdzielczość obrazu jest więc badana przez maszynę, która próbuje znaleźć sposób na przeskalowanie go do wyższej rozdzielczości.

Jeśli rzeczywiście ten projekt uda się Google to znajdzie on mnóstwo zastosowań. To co przychodzi mi na razie na myśl to dobre skalowanie filmów, gier czy obrazów do wyższych rozdzielczości, np. 4K czy w przyszłości 8K. Kolejna rzecz to ponowna analiza starych czy zniszczonych zdjęć czy nagrań, z których będzie można wyciągnąć znacznie więcej ciekawych informacji. A jakie Wy byście widzieli zastosowanie dla tej metody?

Źródło: https://www.techpowerup.com/, https://research.googleblog.com/