Gra w go, pochodząca ze starożytnych Chin, jest jedną z najtrudniejszych do zasymulowania przez komputer. Wiąże się to z ogromną ilością możliwych układów pionków na planszy i wielką ilością możliwości zmiany obrazu gry w każdym ruchu. Ilość możliwych kombinacji o wiele rzędów wielkości przewyższa tą możliwą w szachach, w które komputer IBM Deep Blue wygrał z arcymistrzem Garim Kasparowem w 1997 roku.

Możliwa ilość wszystkich gier w szachach wynosi około 10120. Dla gry w go ta liczba wynosi aż 10761. Oznacza to, że nie ma praktycznie takiej szansy, żeby komputer był w stanie przewidzieć wszystkie możliwe kombinacje przyszłych ruchów tak, jakby to zrobił w przypadku gry w szachy. Jednak za próbę pokonania człowieka w tej rozgrywce zabrało się Google, tworząc do tego celu program AlphaGo.

Zamiast metody „brute force” (przewidywanie wszystkich możliwych rozwojów sytuacji na tyle ruchów do przodu na ile się da) w grze w go postanowiono zastosować sieci neuronowe. Dokładnie dwie. Jedna z nich analizuje 30 milionów ruchów wykonanych przez żywych zawodników, oceniając prawdopodobieństwo doprowadzenia dzięki nim do wygranej. Druga z nich rozgrywa tysiące partii go przeciwko samej sobie ucząc się jak zawęzić krąg kolejnych ruchów prowadzących do korzystnego wyniku.

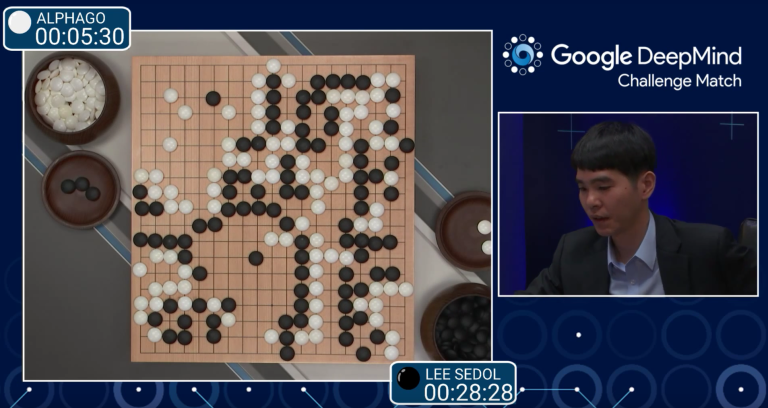

Połączenie dwóch różnych sieci neuronowych daje programowi ogromne możliwości. W październiku ubiegłego roku program po raz pierwszy pokonał profesjonalnego gracza. Jednak to nie wystarczyło inżynierom z Google. Amerykanie wyzwali na pojedynek Lee Sedola, obecnie zajmującego drugie miejsce spośród graczy w go na świecie. Pojedynek składać się ma z pięciu partii go. Dotychczas odbyła się pierwsza, którą… komputer wygrał. Obecnie czekamy na wyniki czterech kolejnych.

[źródło i grafika: popularmechanics.com]