Współpracujące ze sobą zespołu z uniwersytetu Stanforda, Princeton, Instytutu Informatyki Maxa Plancka, Princeton University i Adobe Research pochwaliły się owocem swojej pracy, którym jest kolejny algorytm na bazie sztucznej inteligencji. Ten pozwala na to, o czym wcześniej nawet nie myśleliśmy, a więc precyzyjnej edycji wideo.

Czytaj też: Sztuczna inteligencja DeepMind w Quake III pokazała pazur

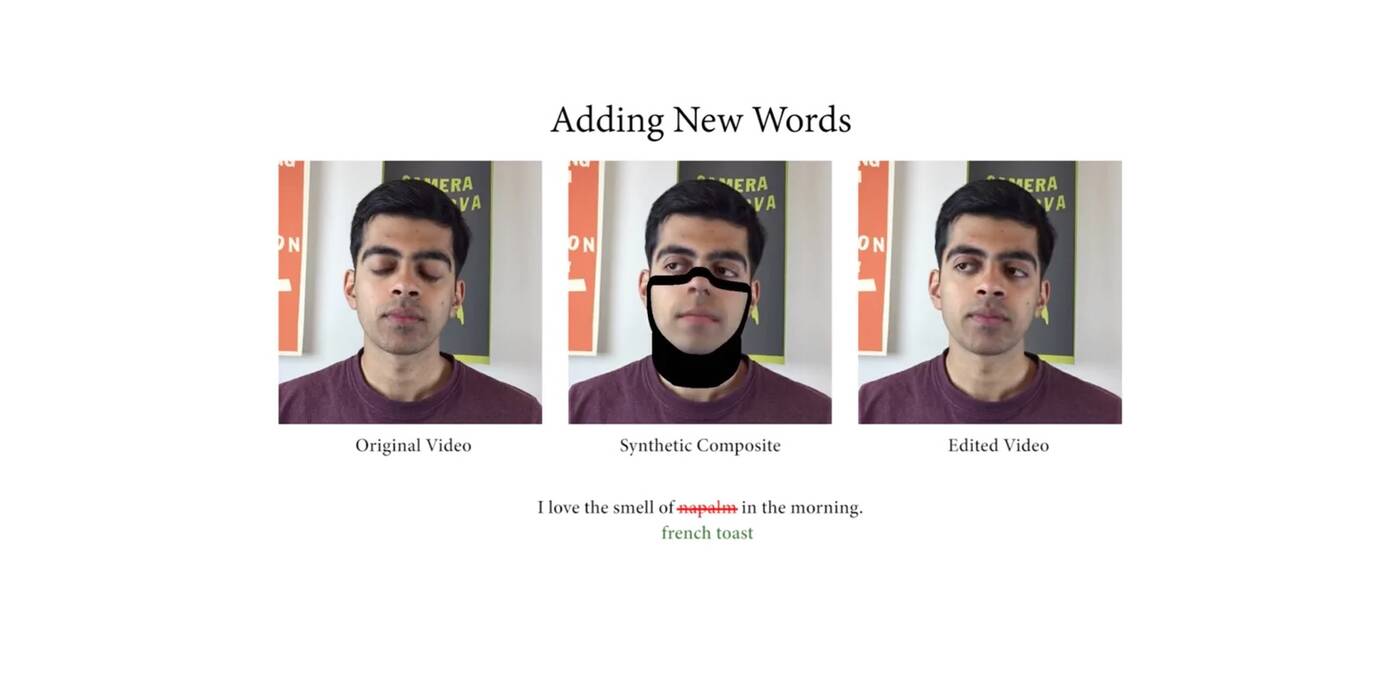

Ten algorytm z grupy deepfake umożliwia przerobienie nagrania wideo tak, aby „włożyć” w usta nagranego człowieka coś, czego nigdy nie powiedział. Zmiany ograniczają się do edycji rodem z programu tekstowego, w którym to po prostu podmieniamy słowa z wypowiadanej przez kogoś kwestii. Tyle przynajmniej musimy zrobić osobiście, bo resztą zajmuje się oprogramowanie, a więc dopasowaniem ruchów twarzy i dźwięku tak, aby ten odpowiadał naszym zmianom. Naukowcy widzą w tym ratunek m.in. dla producentów filmowych, aby ograniczyć wymóg „dokrętek”, kiedy aktor albo da ciała, albo scenariusz ulegnie zmianie.

Aby poznać ruchy twarzy mówcy, algorytm wymaga około 40 minut wideo szkoleniowego i transkrypcji tego, co zostało powiedziane, więc dla dobrych wyników króciutki film nie wystarczy. W przeciągu dłuższego materiału algorytm określa dokładnie zachowania twarzy przy każdej sylabie fonetycznej, co jest oczywiście ważne do dalszego procesu. W jego ramach SI tworzy model 3D postaci, układając go zależnie od podmienionego tekstu. Wynikiem jest fotorealistyczny materiał:

Wystarczy połączyć to z np. VoCo, aby algorytm zrobił to samo w kwestii głosu danej osoby. Po otrzymaniu materiału źródłowego w formie audio, dzieli je na fonemy, a następnie używa uzyskanych zestawów do wygenerowania nowych słów tym samym głosem.

Czytaj też: Sztuczna inteligencja generuje twarze na podstawie głosu

Źródło: New Atlas