Czym są rdzenie Tensor oraz rdzenie RT? Te stały się głównymi bohaterami nowej rodziny kart graficznych GeForce RTX, która poniekąd wygryzła mającą kilkanaście lat na karku rodzinę GeForce GTX. Nie bez powodu, bo jest z nimi związana nowa era grafiki komputerowej.

Wszystko zaczęło się w ostatnich miesiącach 2018 roku, kiedy to najpierw docierały do nas plotki na temat nowych kart graficznych przed wielką premierą serii GeForce RTX 2000. Ta z miejsca stała się głównym rdzeniem oferty NVIDIA dla konsumentów, obiecując znaczącą poprawę wydajności, a przede wszystkim jakości grafiki pod kątem gry cieni i światła.

Co tu dużo mówić, miała nam zapewnić istną rewolucję wizualnych doznań i choć w te obietnice dało się uwierzyć, dopiero jakiś rok po premierze wreszcie nowinki technologiczne zaczęły być wspierane przez wiele gier. Tymi nowinkami są zaimplementowane w rdzeniu graficznym (GPU) rdzenie w postaci rdzeni Tensor oraz rdzeni RT. Warte podkreślenia jest to, że to rzeczywiste, fizyczne konstrukty, które znacząco przewyższają jakiekolwiek programowe rozwiązania.

Rdzenie Tensor

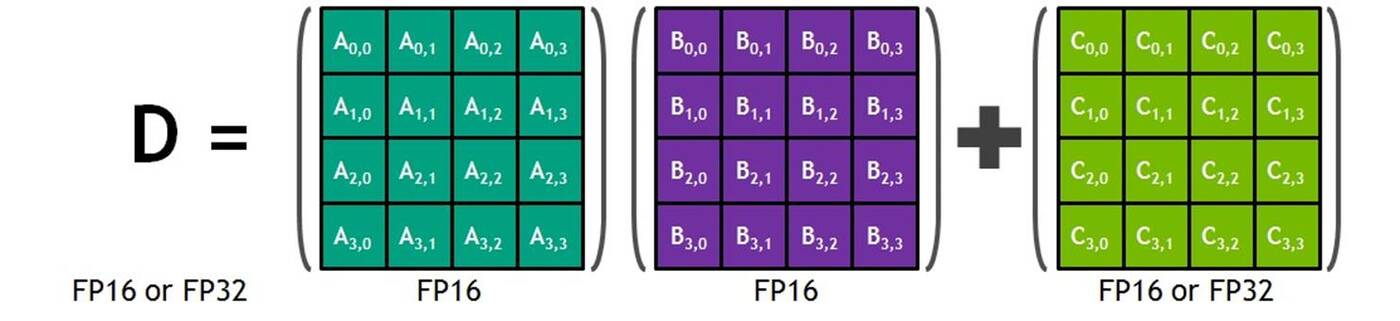

Nie bez powodu NVIDIA wspomina o swoich rdzeniach Tensor, jako o rdzeniach wykonujących obliczenia z mieszaną precyzją, bo choć macierze danych, jakimi się zajmują, mają połowę dokładności, ale rezultat ich operacji może być rezultatem pełnej precyzji. Swoją drogą, tak się akurat składa, że matematyka (tak, to ona jest głównym powodem działania naszych komputerów) wykorzystywana przez rdzenie Tensor jest powszechnie stosowana w głębokim uczeniu (deep-learning).

Obecnie rdzenie Tensor występują w trzeciej generacji za sprawą najnowszych kart graficznych RTX 3000 oraz architektury Ampere. Swoje korzenie Tensory mają jednak znacznie głębiej, bo po raz pierwszy zadebiutowały w niedostępnych dla konsumentów kartach NVIDIA Volta. Tam jednak nie były tak zaawansowane, jak w przypadku architektury Turing i kart RTX 2000.

Zanim jednak wyjaśnimy rolę rdzeni Tensor, warto przypomnieć, że te istnieją obok stosowanych od dawna przez NVIDIA rdzeni CUDA. Te z kolei działają na zasadzie obliczeń, jako że każdy rdzeń CUDA może wykonać jedno precyzyjne obliczenie „na zegar” (stąd tak ważne jest taktowanie GPU). Rdzenie Tensor z kolei operują nie na jednym fragmencie, a macierzy 4×4 (o czterech kolumnach i wierszach) również „na zegar”.

To sprawia, że rdzenie Tensor są w stanie pomnożyć dwie macierze FP16 (połowicznej precyzji) i po ich wyliczeniu dodać do wyniku macierz 4×4 FP32 (pojedynczej precyzji).

Przyjmuje się, że rdzenie CUDA są wolniejsze, ale zapewniają większą precyzję, podczas gdy rdzenie Tensor działają błyskawicznie, jednak po drodze tracą pewną precyzję. Na szczęście bolączki pierwszych Tensorów szybko wyeliminowano, bo te przeżyły rewolucję w swojej drugiej generacji (Turing).

Wtedy to zyskały tryby precyzji INT8 i INT4 do wnioskowania obciążeń, które tolerują kwantyzację oraz pełną obsługę FP16 w przypadku obciążeń wymagających większej precyzji. W rzeczywistości dopiero te rdzenie umożliwiły po raz pierwszy wprowadzenie wykorzystania technik głębokiego uczenia się w czasie rzeczywistym do gier.

Rola rdzeni Tensor

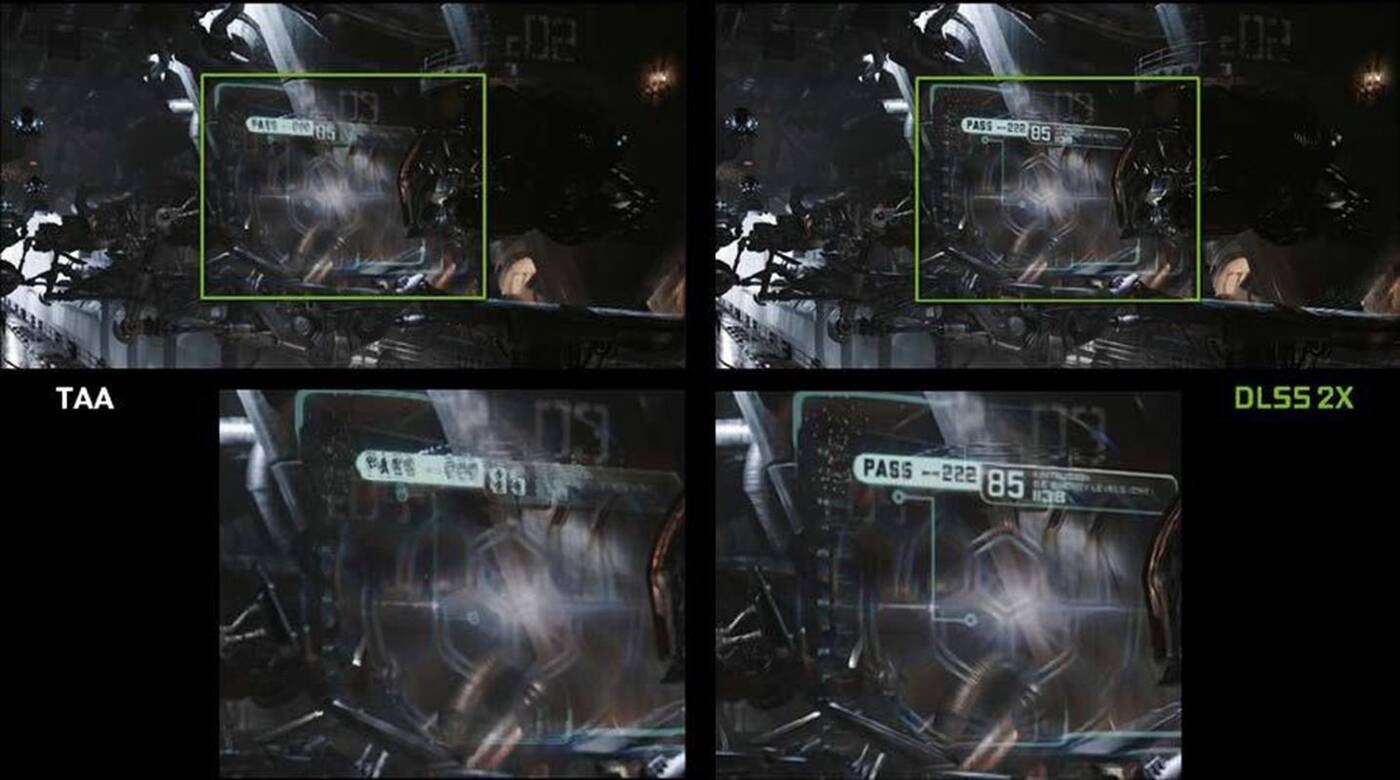

Chociaż zwykliśmy łączyć ze sobą rdzenie Tensor oraz RT pod kątem obliczeń związanych z raytracingiem, to w rzeczywistości rdzenie Tensor wiele do niego nie mają. W rzeczywistości wykorzystuje się je głównie do poprawy finalnej jakości obrazu, ale te same z siebie nie biorą udziału w procesie renderowania. Odpowiadają bardziej za za wypełnienie pustych miejsc w częściowo wygenerowanym na naszym ekranie obrazie, co nazywa się techniką odszumiania.

Mało tego, to dzięki rdzeniom Tensor jest możliwe działanie technologii NVIDIA DLSS w wspierających ją grach. Jej skuteczność najlepiej wykazała ostatnio gra Cyberpunk 2077, która jest na tyle wymagająca, że granie w nią na wyższych rozdzielczościach wręcz wymaga wykorzystania DLSS w myśl poprawy płynności.

Obecnie rozwiązanie to występuje w wersji DLSS 2.1, a to samo w sobie jest skrótem od Deep Learning Super Sampling, czyli techniki głębokiego uczenia, która wykorzystuje sztuczną inteligencję do inteligentnego skalowania renderowanych klatek do wyższej rozdzielczości. To rdzenie Tensor odpowiadają właśnie za obliczenia związane ze sztuczną inteligencją w tym wypadku.

Rdzenie RT

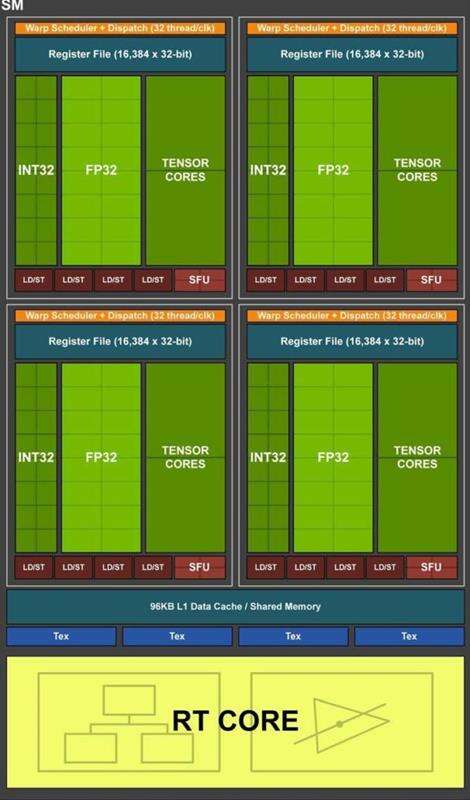

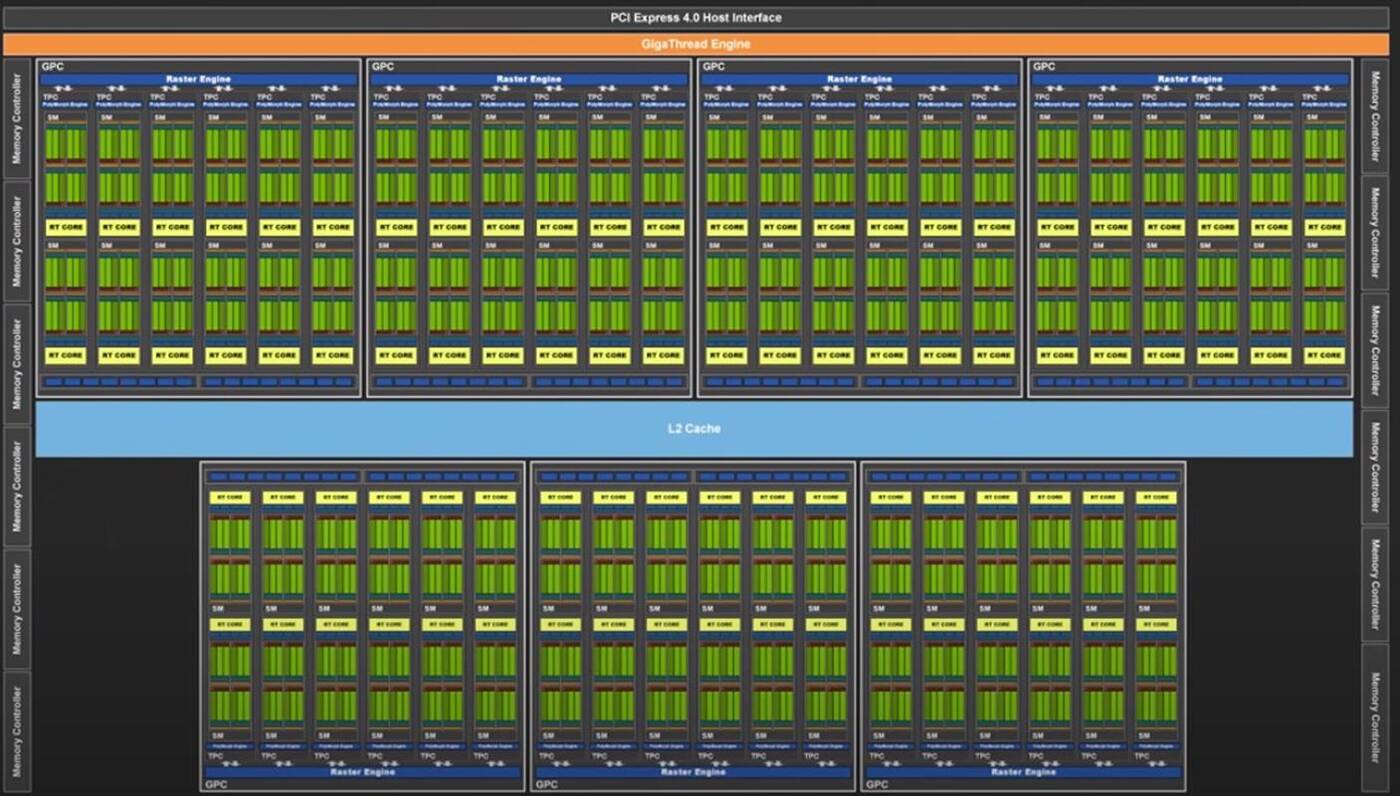

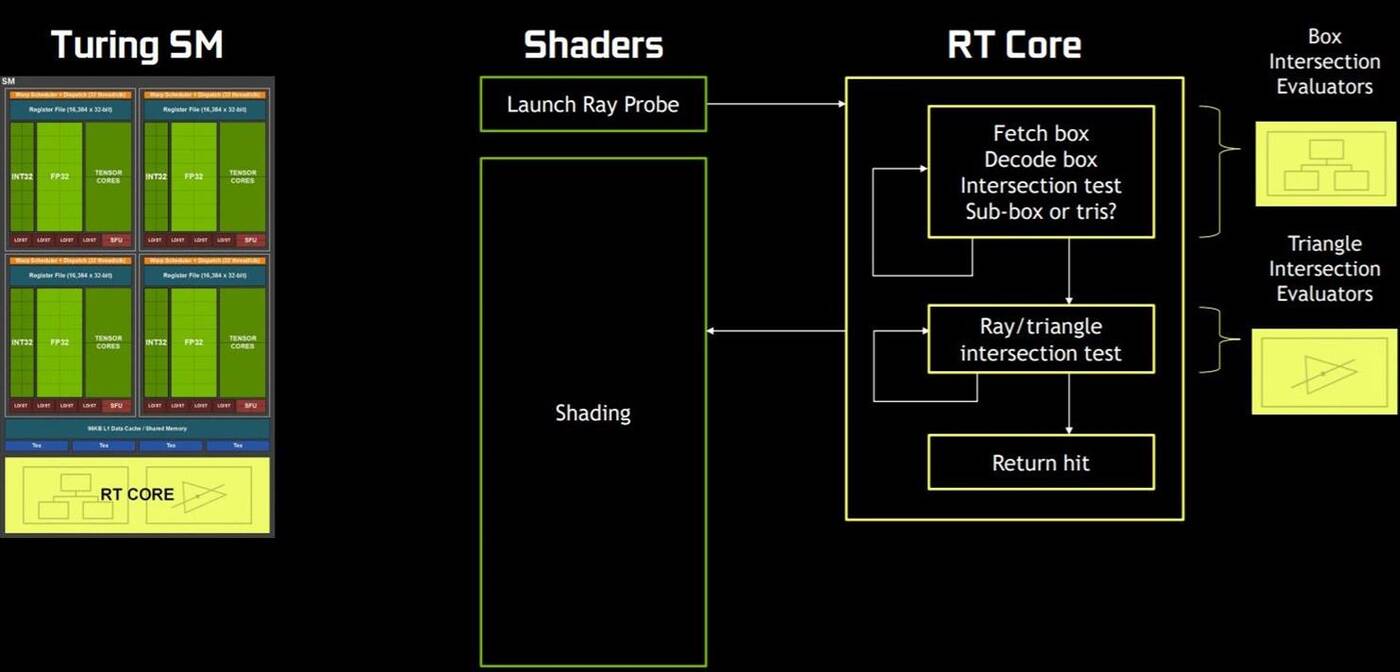

Kolejnym składnikiem każdego bloku SM nowych kart graficznych RTX Nvidii są wspomniane rdzenie RT. Te z kolei w zupełności odpowiadają za działanie technologii real-time raytracingu, czyli śledzenia promieni w czasie rzeczywistym, co jest niemożliwe na starszych kartach Nvidii pozbawionych tych konkretnych rdzeni. Dla nich firma wymyśliła nawet nowy rodzaj wydajności w formie Giga Rays na sekundę.

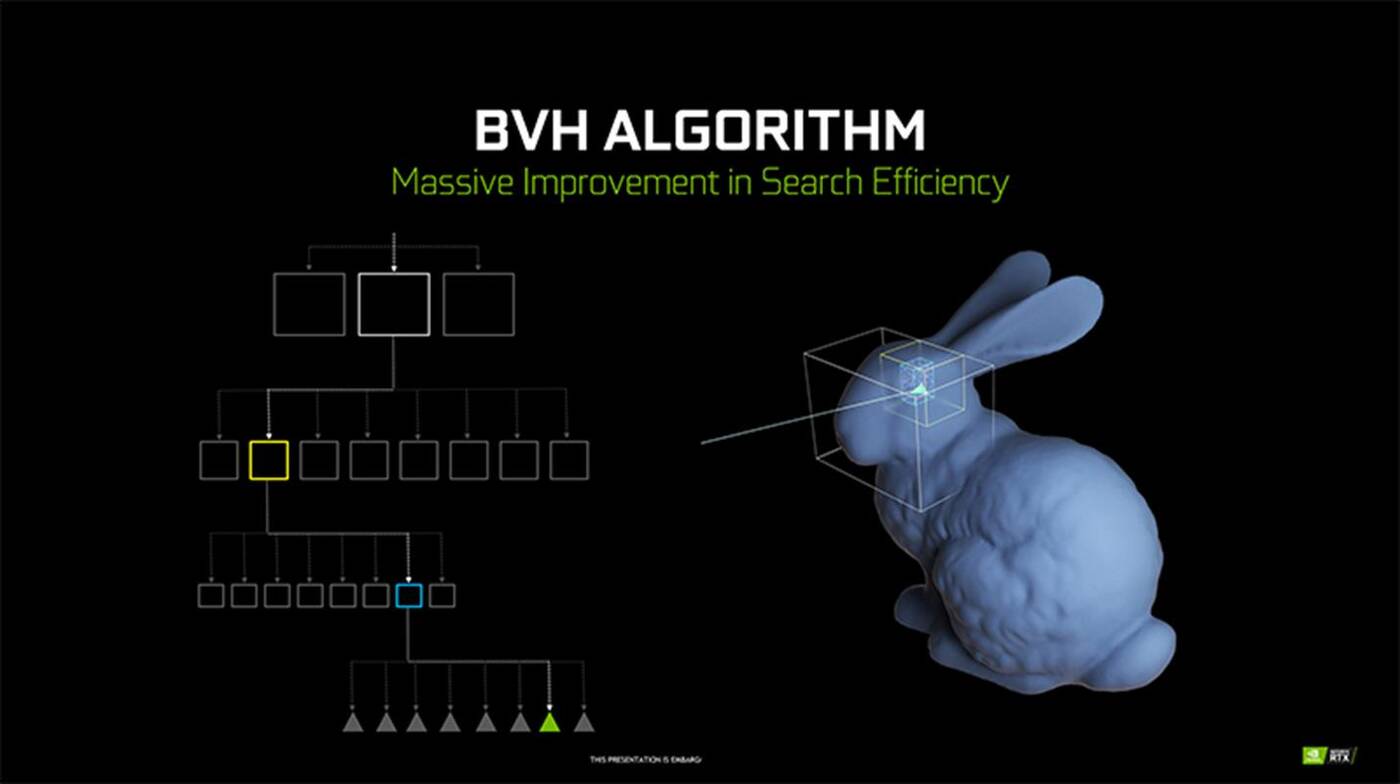

Rdzenie RT składają się z dwóch wyspecjalizowanych układów, z których pierwszy przeprowadza testy pola granicznego, a drugi wykonuje testy przecięcia trójkątów promieni. Dzięki temu cały blok może zajmować się obliczaniem innych części grafiki, a to wszystko zostało zamknięte w algorytmie BVH (ang. Bounding Volume Hierarchy), który dzieli scenę na strefy i na podstawie zachowania promieni rozchodzących się ze źródeł światła poprzez ich śledzenie, generuje drzewo hierarchii, które pozwala w bardzo prosty sposób prześledzić, jak zachowuje się promień.

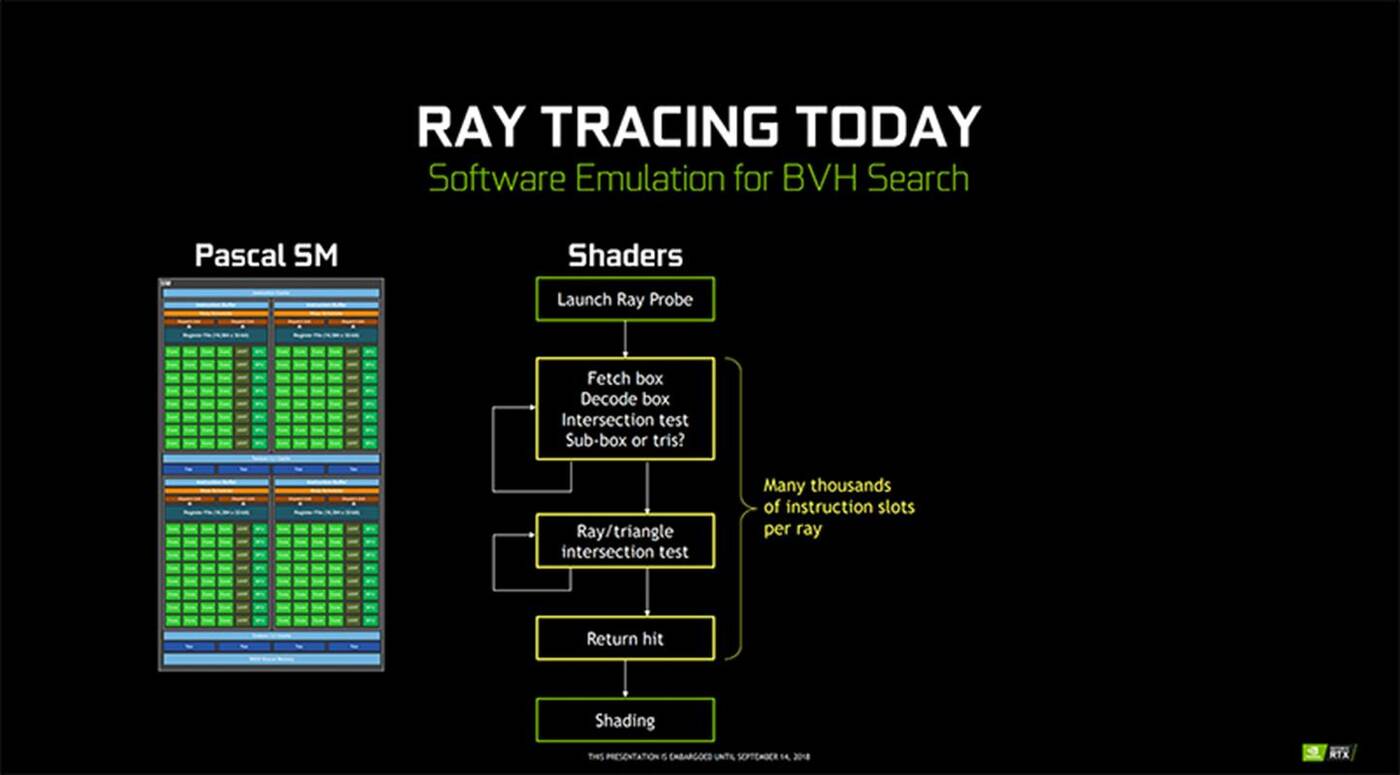

Procesory graficzne bez dedykowanych rdzeni (tutaj RT) do śledzenia promieni w BVH muszą wykorzystywać „podstawową moc obliczeniową” karty, co mija się z celem, bo znacząco wpływa na obciążenie sprzętu, obniżając płynność.

Rola rdzeni RT

Dzięki rdzeniom RT, umożliwiającym w rzeczywistości działanie raytracingu, jest możliwe tworzenie bardziej realistycznych odbić, załamań i cieni, a nawet zastąpienie tradycyjnych technik rastrowych. Jednak w rzeczywistości, raytracing zamiast całkowicie zastępować rasteryzację, może też zapewniać informacje w myśl rozszerzenia jakości cieniowania, zapewniając znacznie bardziej fotorealistyczny efekt i to zwłaszcza w odniesieniu do działań poza kamerą.