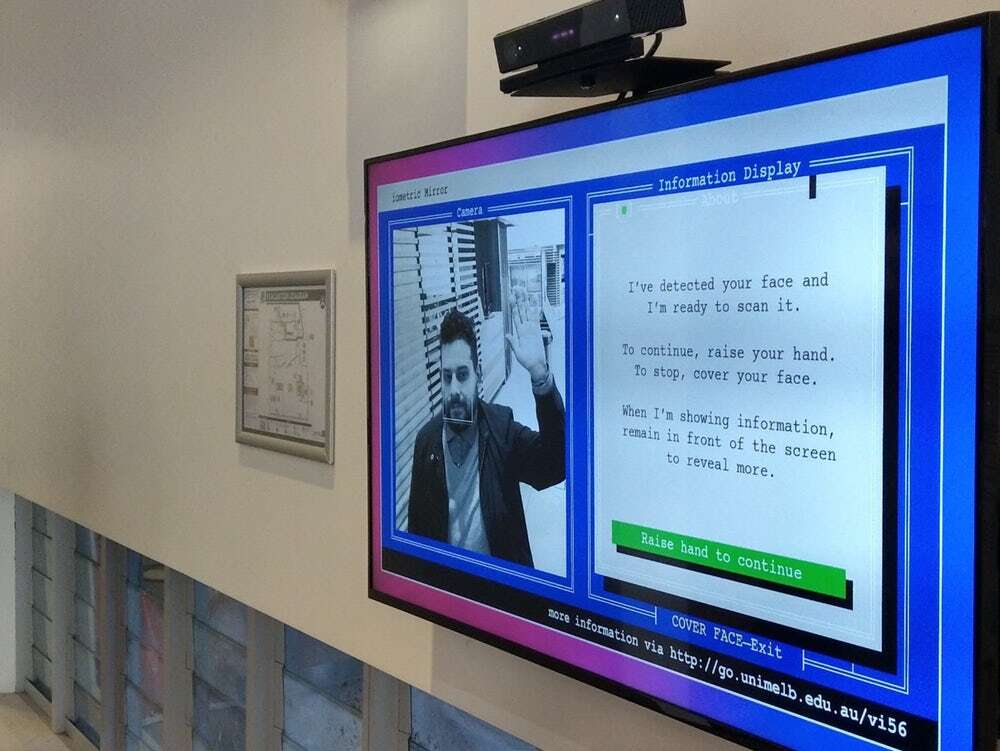

SocialNUI i galeria nauki w Melbourne zaprezentowała właśnie Biometric Mirror. To sprytne urządzenie bazujące na sztucznej inteligencji znajduje się teraz w tamtejszej bibliotece i zajmuje się oceną wszystkich chętnych. Jak się okazuje – niezbyt precyzyjnie.

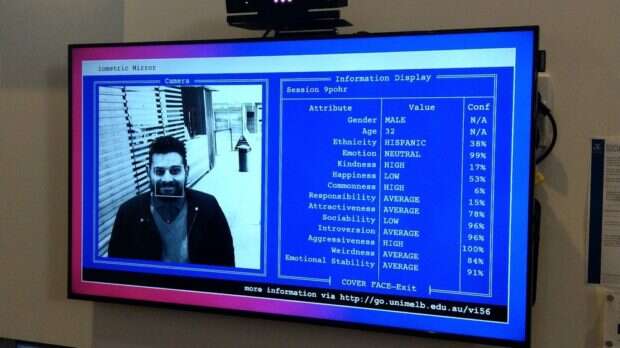

Wszystko po to, aby ujawnić, w jaki to sposób technologia może wzmacniać ludzkie uprzedzenia na podstawie wcześniej zebranych danych. To przecież wyłącznie maszyna, która nie czyta nam w mózgu, a swoje „wyliczenia” opiera na informacjach z kilku tysięcy zdjęć twarzy. Te oceniło następnie ponad 30000 osób, które nie wskazywały wyłącznie wieku, płci, czy pochodzenia, ale również subiektywne oceny cech tych osób. Pod lupę wzięto poziom szczęścia, agresywność, „dziwność”, stabilność emocjonalną, powszechność, uprzejmość, czy nawet atrakcyjność. Wyniki tego „badania” trudno więc uznać za specjalnie dokładne.

Początkowo mogłoby się wydawać, że celem Biometric Mirror jest ulepszenie mechanizmów oceny osobowości, ale (przynajmniej oficjalnie) to nieprawda. Jak tłumaczy Niels Wouters, główny badacz projektu z uniwersytetu w Melbourne:

Chcemy podnieść świadomość, że skoro taka technologia jest skomercjalizowana i już znajdziemy na rynku takie aplikacje, może to mieć poważne konsekwencje. Jeśli będąc ubezpieczycielem, dostanę informację, że jesteś nieodpowiedzialny, to dlaczego nie zwiększyłbym Ci opłat?

A gdzie możemy znaleźć już namiastkę takich systemów? Na przykład na ulicach w Chinach, czy USA, gdzie obecne wszędzie kamery nieustannie skanują ludzi w celu znalezienia obecnie poszukiwanych przestępców.

Źródło: BiometricMirror

Zdjęcia: NewAtlas